Cloud-KI ist der Mainframe. Apple Silicon ist der Personal Computer.

Die größte Wette in der Tech-Branche dreht sich nicht darum, wer das beste KI-Modell baut. Sondern darum, wo Intelligenz lebt. Cloud-KI-Anbieter geben 690 Milliarden Dollar für zentralisierte Infrastruktur aus. Apple gibt 13 Milliarden für Silizium aus, das den Großteil davon überflüssig machen könnte.

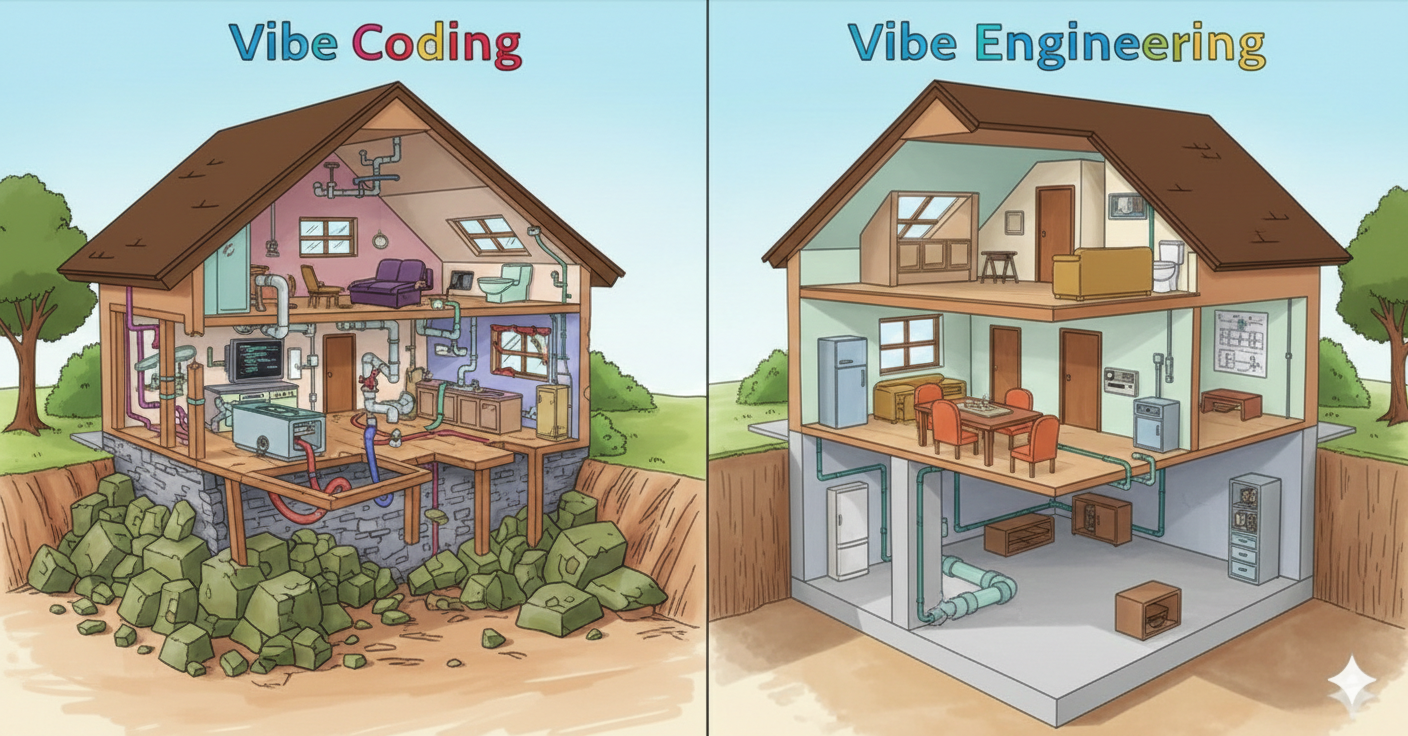

Cloud-KI ist der Mainframe. Apple Silicon ist der Personal Computer.

Die größte Wette in der Tech-Branche dreht sich gerade nicht darum, wer das beste KI-Modell baut. Sondern darum, wo Intelligenz lebt. Und diesen Film haben wir schon mal gesehen.

1964 brachte IBM den System/360 auf den Markt - eine 5-Milliarden-Dollar-Wette auf eine Familie von Großrechnern, die die Branche zwei Jahrzehnte lang dominieren sollte. Zentralisiert. Leistungsstark. Teuer. Bis 1970 kontrollierte IBM über 70 % des Computermarktes [1]. Die verbliebenen Wettbewerber waren so chancenlos, dass sie den Spitznamen "die sieben Zwerge" bekamen.

Dann passierte etwas, das bei IBM niemand ernst nahm. Kleine, billige "Spielzeug"-Computer tauchten auf Schreibtischen auf. Sie konnten keine Flugbuchungssysteme betreiben. Sie konnten keine Millionen von Banktransaktionen verarbeiten. Aber sie konnten Tabellenkalkulationen ausführen. Und Textverarbeitung. Und das reichte.

Innerhalb von 15 Jahren hatte der Personal Computer das IBM-Imperium zerlegt. Nicht weil er leistungsfähiger war - sondern weil er überall war.

Ich glaube, wir beobachten gerade exakt dasselbe Muster bei künstlicher Intelligenz. Und die meisten Leute schauen in die falsche Richtung.

Die Mainframes der KI

Fangen wir mit dem an, was jeder sehen kann.

OpenAI, Google, Anthropic, Microsoft, Meta - diese Unternehmen bauen die Mainframes der KI-Ära. Zentralisierte Systeme von außergewöhnlicher Leistung, betrieben auf massiven GPU-Clustern in Rechenzentren, die so viel Strom verbrauchen wie kleine Städte. Die Zahlen sind atemberaubend.

Die fünf größten Hyperscaler - Amazon, Microsoft, Google, Meta und Oracle - haben sich verpflichtet, allein 2026 zwischen 660 und 690 Milliarden Dollar für Investitionsausgaben auszugeben [2]. Davon fließen rund 75 % in KI-Infrastruktur [3]. OpenAI hat KI-Infrastruktur-Deals im Wert von etwa 1 Billion Dollar angekündigt [4]. Das Stargate-Projekt plant 500 Milliarden Dollar über vier Jahre.

Das sind Mainframe-Dimensionen. Zentralisiert. Kapitalintensiv. Abhängig von Skaleneffekten, die sich nur eine Handvoll Organisationen leisten kann. Kommt dir bekannt vor?

IBMs Mainframe-Kunden in den 1970ern griffen über Terminals auf Rechenleistung zu, die mit einem zentralen Rechner verbunden waren. Heutige KI-Nutzer greifen über Browser und APIs auf Intelligenz zu, die mit zentralen Rechenzentren verbunden ist. Die Architektur ist verblüffend ähnlich - ein leistungsstarkes zentrales Gehirn, dumme Endgeräte und ein Netzwerk dazwischen.

Und genau wie in der Mainframe-Ära funktioniert das zentralisierte Modell hervorragend für seinen vorgesehenen Zweck. GPT-5, Claude, Gemini - diese Modelle sind außergewöhnlich. Sie können auf einem Niveau denken, schreiben, programmieren und analysieren, das vor fünf Jahren unmöglich schien. Für komplexe Aufgaben, die Frontier-Intelligenz erfordern, wird Cloud-KI noch lange unverzichtbar bleiben.

Aber das ist die Sache mit Mainframes. Die blieben auch noch lange unverzichtbar. Viele laufen heute noch [5] und verarbeiten Banktransaktionen und Flugbuchungen. IBM verkauft sie immer noch. Der Mainframe ist nicht gestorben.

Er wurde nur irrelevant für 95 % dessen, wofür die Menschen Computer tatsächlich brauchten.

Das Personal-Computer-Muster

Der Übergang vom Mainframe zum PC folgte einem bestimmten Muster, das Clayton Christensen später in seinem wegweisenden Buch The Innovator's Dilemma von 1997 als "disruptive Innovation" kodifizierte [6]. Dieses Muster zu verstehen ist der Schlüssel, um zu begreifen, was gerade bei KI passiert.

Phase 1: Der zentralisierte Pionier schafft den Markt. IBMs Mainframes bewiesen, dass Computer Unternehmen transformieren konnten. Sie waren teuer, brauchten spezialisiertes Personal und standen in eigenen Räumen. Aber sie zeigten den Wert von Rechenleistung an sich. Ohne Mainframes hätte niemand gewusst, wozu Computer gut sind.

Phase 2: Die Technologie wird "gut genug" für kleinere Formfaktoren. Als Prozessoren billiger und effizienter wurden, war es möglich, einen Computer auf einen Schreibtisch zu stellen. Der Apple II (1977), der IBM PC (1981) [7] und ihre Klone waren nicht so leistungsfähig wie Mainframes. Aber sie waren leistungsfähig genug für die Aufgaben, die einzelne Mitarbeiter brauchten: Dokumente schreiben, Berechnungen durchführen, Daten verwalten.

Phase 3: Distribution und Zugänglichkeit schlagen rohe Leistung. Mitte der 1980er gab es Millionen von PCs und nur Tausende von Mainframes. Die Ökonomie kippte. Softwareentwickler bauten für PCs, weil dort die Nutzer waren. Netzwerke verbanden PCs miteinander und gaben ihnen Fähigkeiten, die an Mainframe-Niveau heranreichten. Die "gut genug"-Schwelle stieg immer weiter, bis PCs fast alles bewältigen konnten.

Phase 4: Der Wert wandert. IBMs Fehler war nicht, in den PC-Markt einzusteigen - sie bauten tatsächlich den IBM PC. Ihr Fehler war, Standardkomponenten zu verwenden und Microsofts Betriebssystem zu lizenzieren, statt proprietäre Systeme zu entwickeln. IBM legitimierte den PC und sah dann zu, wie der Wert abwanderte [8] - von Hardware (wo IBM den Vorteil hatte) zu Software (wo Microsoft ihn übernahm) und Prozessoren (wo Intel ihn übernahm). 1993 verbuchte IBM einen Verlust von 8,2 Milliarden Dollar [9] - damals der größte in der US-Unternehmensgeschichte.

Der PC gewann nicht, weil er besser war als der Mainframe. Er gewann, weil er überall war - auf jedem Schreibtisch, in jedem Zuhause, persönlich und zugänglich. Macht verschob sich von zentralisiert zu verteilt. Von institutionell zu individuell. Vom Rechenzentrum zum Desktop.

Jetzt übertrage das auf KI

Die Parallelen sind fast schon zu offensichtlich.

Die heutigen Cloud-KI-Dienste sind die Mainframes. ChatGPT, Claude, Gemini - sie sind zentralisiert, leistungsstark, teuer im Betrieb und werden von einer Handvoll Unternehmen kontrolliert. Du greifst über ein Terminal (deinen Browser) auf sie zu, das mit einem zentralen Rechner (einem GPU-Cluster in einem Rechenzentrum) verbunden ist. Die KI-Unternehmen, die diese Systeme bauen, geben jährlich Hunderte Milliarden [10] für zentralisierte Infrastruktur aus.

On-Device-KI ist der Personal Computer. Modelle, die lokal auf deinem Handy, Laptop oder Tablet laufen. Kleiner, weniger leistungsfähig als die Cloud-Modelle. Aber persönlich. Privat. Immer verfügbar. Und sie werden exponentiell besser.

Und hier kommt Apple ins Spiel.

Apple Silicon: Der Chip für den PC-Moment der KI

Während der Rest der Tech-Branche um die Wette größere Rechenzentren baut, hat Apple still und leise etwas anderes entwickelt: das fortschrittlichste Consumer-KI-Silizium der Welt.

Die Entwicklung spricht für sich:

Apples Neural Engine - der dedizierte KI-Prozessor in jedem Apple-Chip - liegt auf einer exponentiellen Verbesserungskurve [11]. Der M1 (2020) lieferte 11 Billionen Operationen pro Sekunde (TOPS). Der M4 (2024) erreichte 38 TOPS [12] - mehr als das Dreifache. Und der M5, Ende 2025 vorgestellt, springt auf rund 133 TOPS [13] - eine 12-fache Verbesserung gegenüber dem M1 in nur fünf Jahren.

Kurz erklärt: TOPS steht für Trillion Operations Per Second und misst, wie viele KI-spezifische Berechnungen ein Chip durchführen kann. Es ist die zentrale Kennzahl für die Neural Engine - den Teil des Chips, der speziell für Machine Learning gebaut wurde. Um Apples Entwicklung einzuordnen: Die 11 TOPS des M1 im Jahr 2020 waren beeindruckend für einen Laptop-Chip. Die 133 TOPS des M5 fünf Jahre später nähern sich der Leistung einer einzelnen Server-GPU wie Nvidias H100 - aber in einem lüfterlosen Laptop, der auf Akku läuft.

Aber die reinen TOPS sind nicht einmal die wichtigste Zahl. Der M5 führte etwas architektonisch Neuartiges ein [14]: Neural Accelerators in jedem GPU-Kern, die KI-Workloads über den gesamten Chip verteilen, statt sie durch eine einzelne Engine zu schleusen. Apps wie LM Studio können jetzt große Sprachmodelle lokal auf einem MacBook ausführen. Der M5 liefert über 4-fache Peak-GPU-Rechenleistung für KI-Workloads im Vergleich zum M4.

Und das ist nur der Basis-M5-Chip. Prognosen für den M5 Ultra deuten auf 600-800 TOPS hin - in der Nähe der Leistung einer einzelnen Rechenzentrums-GPU, aber auf einem Desktop, lautlos und mit einem Bruchteil des Stromverbrauchs.

Auf der iPhone-Seite führt der A18 Pro Apples On-Device-Sprachmodell bereits mit 30 Tokens pro Sekunde bei einer First-Token-Latenz von nur 0,6 Millisekunden aus [15]. Das ist schneller als die meisten Cloud-API-Aufrufe, weil kein Netzwerk-Roundtrip nötig ist.

Apples Unified Memory Architecture ist das andere entscheidende Puzzlestück. Anders als bei traditionellen PCs, wo CPU und GPU separate Speicherpools haben, gibt Apple Silicon der Neural Engine, GPU und CPU gemeinsamen Zugriff auf schnellen Speicher - bis zu 128 GB beim M4 Max mit über 500 GB/s Bandbreite [16]. Das ist enorm wichtig für KI, denn das Ausführen von Sprachmodellen ist grundsätzlich ein Memory-Bandwidth-Problem [17]: Jeder Token erfordert das Streaming der vollständigen Modellgewichte durch den Speicher.

Das ist kein Zufall. Apple hat seit Jahren Silizium speziell für On-Device-KI entwickelt. Die Neural Engine erschien erstmals im A11 Bionic 2017 [18] - bevor ChatGPT existierte. Apple reagierte nicht auf das KI-Rennen. Sie bauten die Infrastruktur dafür.

Warum Apple keine Rechenzentren bauen muss

An diesem Punkt drängt sich eine offensichtliche Frage auf: Wenn Apple Silicon so energieeffizient und leistungsfähig für KI-Workloads ist, warum baut Apple nicht einfach Server für Rechenzentren und konkurriert mit Nvidia?

Die kurze Antwort: Apple muss nicht das Rechenzentrum gewinnen. Apple muss das Rechenzentrum überflüssig machen - zumindest für den Teil des Marktes, der Apple interessiert.

Um zu verstehen warum, muss man den Unterschied zwischen zwei grundlegend verschiedenen KI-Workloads verstehen: Training und Inference.

Training bedeutet, ein Modell zu unterrichten. Es ist der Prozess, bei dem Unternehmen wie OpenAI Billionen von Text-Tokens in ein neuronales Netz einspeisen und Milliarden von Parametern über Wochen oder Monate anpassen. Das erfordert wahnsinnige Mengen paralleler Rechenleistung - Tausende von GPUs, die gleichzeitig an einer einzigen massiven Aufgabe arbeiten. Dafür wird der Großteil der 690 Milliarden Dollar für Rechenzentren ausgegeben. Nvidia dominiert hier, weil ihre Architektur genau dafür gebaut ist: massive Parallelisierung über Tausende GPUs in einem Cluster.

Inference bedeutet, ein trainiertes Modell zu nutzen. Es ist das, was passiert, wenn du ChatGPT eine Frage stellst oder wenn Siri deine Benachrichtigungen zusammenfasst. Man nimmt ein fertiges Modell, gibt einen Input ein und bekommt einen Output. Das ist ein grundlegend anderes Rechenproblem. Es erfordert keine Tausende von GPUs im Verbund. Es erfordert das effiziente Ausführen eines einzelnen Modells, idealerweise so schnell und günstig wie möglich.

Apple Silicon ist nicht für Training designt. Es ist für Inference designt. Die Unified Memory Architecture - bei der CPU, GPU und Neural Engine denselben Speicherpool teilen - ist perfekt dafür, ein Modell einmal in den Speicher zu laden und es effizient für einen Nutzer auf einem Gerät auszuführen. Nvidias Architektur ist für ein völlig anderes Problem designt: Tausende Nutzer, ein riesiger Cluster, massive Modelle, die gleichzeitig trainiert oder bereitgestellt werden.

Diese Unterscheidung ist das Herzstück der Mainframe-Analogie. Mainframes waren für zentralisierte, industrielle Workloads gebaut. PCs waren für individuelle, persönliche Workloads gebaut. Beides sind "Computer" - aber für völlig unterschiedliche Aufgaben optimiert. Cloud-KI-Infrastruktur ist der Mainframe: gebaut für Training und Large-Scale Inference Serving. Apple Silicon ist der PC: gebaut für persönliche, On-Device-Inference.

Und hier wird es strategisch spannend: Die KI-Branche verschiebt sich von Training zu Inference [19]. Deloitte schätzt, dass Inference 2026 bereits zwei Drittel aller KI-Rechenleistung ausmacht, gegenüber einem Drittel 2023. Je mehr Modelle trainiert und eingesetzt werden, desto mehr kippt das Verhältnis Richtung Inference. Und wenn ein wachsender Anteil dieser Inference auf dem Gerät stattfindet statt in der Cloud - auf Apple Silicon statt auf Nvidia-GPUs - dann erobert Apple das größte und am schnellsten wachsende Segment der KI-Rechenleistung, ohne ein einziges Rechenzentrum zu bauen.

Apple betreibt tatsächlich bereits eigene Apple-Silicon-Server - ein System namens Private Cloud Compute [20]. Wenn dein iPhone auf eine KI-Aufgabe stößt, die zu komplex für On-Device-Verarbeitung ist, wird sie an Apple-designed Server mit Apple-Chips weitergeleitet, mit End-to-End-Verschlüsselung und zustandsloser Berechnung. Aber das ist kein Rechenzentrumsgeschäft. Es ist ein Sicherheitsnetz für die Fälle, in denen On-Device noch nicht reicht - und dieses Sicherheitsnetz schrumpft jedes Mal, wenn Apple einen leistungsfähigeren Chip ausliefert.

Der PC gewann nicht, indem er einen besseren Mainframe baute. Er gewann, indem er den Mainframe für die meisten Menschen überflüssig machte. Apples Wette ist dieselbe: Bau kein besseres Rechenzentrum. Bau einen Chip, der so gut ist, dass die meisten Konsumenten keins brauchen.

Die "gut genug"-Linie verschiebt sich schnell

Die wichtigste Frage in jeder Disruptions-Geschichte lautet: Wann wird die unterlegene Technologie "gut genug" für den Mainstream?

Bei On-Device-KI verschiebt sich diese Schwelle schneller, als fast jeder erwartet hat.

2023 war das Ausführen eines Sprachmodells auf dem Handy eine Spielerei - langsam, begrenzt, kaum nützlich. Bis 2025 hatte sich die Landschaft komplett gewandelt. Sub-Milliarden-Parameter-Modelle können mittlerweile viele praktische Aufgaben bewältigen [21]: Textzusammenfassung, Schreibassistenz, Code Completion, Fotobearbeitung, Übersetzung. Forschung zeigt, dass kleine Modelle, die mit hochwertigen Daten trainiert und aus größeren Modellen destilliert wurden, Basismodelle um ein Vielfaches ihrer Größe bei Reasoning-Benchmarks übertreffen können.

Auf der WWDC 2025 veröffentlichte Apple sein Foundation Models Framework [22], das Entwicklern kostenlosen Zugang zu einem On-Device-Modell mit etwa 3 Milliarden Parametern gibt - mit nur drei Zeilen Swift-Code. Inference-Kosten: null. Netzwerkanforderung: keine. Datenschutz: vollständig. Das ist Apples Äquivalent zur offenen PC-Architektur - aber mit Apples Plattformkontrolle.

Die Forschungsgemeinschaft bestätigt die Entwicklung. Ein Paper vom Januar 2025 ergab, dass hybride Edge-Cloud-Ansätze Energieeinsparungen von bis zu 75 % und Kostenreduktionen von über 80 % [23] im Vergleich zu reiner Cloud-Verarbeitung liefern können. Deloitte prognostiziert [19], dass Inference-Workloads 2026 etwa zwei Drittel aller KI-Rechenleistung ausmachen werden, gegenüber einem Drittel 2023. Und der Trend ist unverkennbar: Immer mehr dieser Inference wandert an die Edge [24].

Der Trade-off ist klar und gut verstanden. Frontier Reasoning - die Art von tiefgehender, mehrstufiger Analyse, bei der GPT-5 und Claude glänzen - erfordert weiterhin Cloud-Scale-Compute. Aber alltägliche Aufgaben wie Textformatierung, schnelle Fragen beantworten, Benachrichtigungen zusammenfassen, Fotos bearbeiten, persönliche Assistenten betreiben? Dafür sind On-Device-Modelle bereits gut genug. Und "gut genug" auf dem eigenen Gerät, privat und sofort, schlägt "besser" in einem entfernten Rechenzentrum für die meisten Consumer-Anwendungsfälle.

Genau das passierte mit PCs gegenüber Mainframes. Der PC war nie besser als der Mainframe in dem, was Mainframes am besten konnten. Aber er war um Längen besser in dem, was die meisten Menschen tatsächlich brauchten.

Apples Distributions-Burggraben: 2,5 Milliarden Geräte

Hier wird die Mainframe-zu-PC-Analogie richtig interessant.

IBM kontrollierte 70 % des Mainframe-Marktes. Aber es gab nur Tausende von Mainframes weltweit. Der PC-Markt wuchs schnell auf Millionen, dann Hunderte Millionen Einheiten. Die schiere Anzahl an PCs bedeutete: Dort entwickelten Softwareentwickler, was mehr Nutzer anzog, was mehr Entwickler anzog. Der Flywheel-Effekt zerstörte die Vorteile des Mainframes.

Apple hat 2,5 Milliarden aktive Geräte [25] - iPhones, iPads, Macs, Apple Watches, Apple Vision Pro. Jedes einzelne hat eine Neural Engine. Das ist der größte einzelne Distributionskanal für KI-Hardware in der Geschichte. Und geschätzt 70 % der aktiven iPhone-Basis können Apple Intelligence noch nicht ausführen, was einen massiven potenziellen Upgrade-Zyklus schafft.

Wenn Apple ein KI-Feature ausliefert, geht es nicht an ein paar Millionen Early Adopter. Es geht gleichzeitig an Milliarden von Geräten. Kein Cloud-KI-Anbieter kann diese Distribution matchen. ChatGPT hat rund 200 Millionen monatlich aktive Nutzer. Meta AI behauptet über 1 Milliarde [26]. Aber diese Nutzer greifen über Apps und Browser auf KI zu - sie besitzen keine KI-fähige Hardware, die Inference lokal ausführt.

Apples Strategie ist, jedes Gerät in seinem Ökosystem zu einem KI-fähigen Computer zu machen. Nicht ein Terminal, das mit einem zentralen Gehirn verbunden ist - sondern ein tatsächlich intelligentes Gerät, das die Cloud nur dann anruft, wenn es muss.

Die 690-Milliarden-Dollar-Frage

Zoomen wir raus und schauen auf die Ökonomie.

Die Hyperscaler - Amazon, Microsoft, Google, Meta, Oracle - planen, 2026 rund 690 Milliarden Dollar für Infrastruktur auszugeben [2]. OpenAI allein hat KI-Infrastruktur-Deals im Wert von etwa 1 Billion Dollar angekündigt [4]. Das sind Mainframe-Dimensionen von Investitionen in zentralisiertes Computing.

Apples KI-Investitionsausgaben? Etwa 13 Milliarden Dollar [27]. Weniger als 2 % dessen, was die Hyperscaler ausgeben.

Die Bären sehen das als Beweis, dass Apple das KI-Rennen verliert. Aber was, wenn Apple gar nicht dasselbe Spiel spielt?

In der Mainframe-Ära gab IBM enorme Summen für zentralisierte Infrastruktur aus. Aber der Wert wanderte schließlich zur verteilten Schicht - PCs, ihre Betriebssysteme und die Software, die darauf lief. Die Unternehmen, die am meisten für Mainframe-Technologie ausgaben, gewannen nicht die nächste Ära. Die Unternehmen, die Rechenleistung in die Hände der Menschen legten, gewannen.

Apple wettet - ob bewusst oder per Default - dass dasselbe mit KI passieren wird. Die Cloud-KI-Giganten werden Billionen für zentralisierte Infrastruktur ausgeben. Und Apple wird den Wert an der Edge ernten, mit immer leistungsfähigeren Modellen auf 2,5 Milliarden Geräten, bei null marginalen Inference-Kosten, vollständigem Datenschutz und sofortigen Antwortzeiten.

Wenn KI-Modelle weiter commoditisieren - und API-Preise sind seit GPT-3 um 97 % gefallen [28] - dann könnte der Aufbau der weltbesten KI-Hardwareplattform deutlich wertvoller sein als der Bau des weltbesten KI-Modells.

Wo die Analogie nicht aufgeht

Um intellektuell ehrlich zu sein, müssen wir anerkennen, wo dieses Framing nicht funktioniert.

On-Device-KI wird vielleicht nicht schnell genug gut genug. Der Mainframe-zu-PC-Übergang dauerte 15 Jahre. Die Smartphone-Revolution etwa 5. KI bewegt sich noch schneller - aber die Kluft zwischen On-Device- und Cloud-Modellen ist bei komplexen Reasoning-Aufgaben immer noch enorm. Wenn die nächste Welle des KI-Werts aus agentischen Workflows und Deep Reasoning kommt - Aufgaben, die Frontier-Modelle erfordern - dann könnte On-Device-KI eher eine Ergänzung zur Cloud bleiben als ein Ersatz.

Apples Umsetzung war wirklich schlecht. Der Siri-Umbau, auf der WWDC 2024 angekündigt, sollte revolutionär sein. Er wurde 21 Monate zu spät ausgeliefert, mit einer berichteten Fehlerrate von einem Drittel [29] bei internen Tests. Apples KI-Chef John Giannandrea trat im Dezember 2025 ab [30], nach dem, was Bloomberg als "turbulente Amtszeit" beschrieb. Mindestens zwölf Top-KI-Forscher haben das Unternehmen verlassen, viele zu Meta [31]. Apple Intelligence Notification-Zusammenfassungen erzeugten erfundene Schlagzeilen [32], die Klagen auslösten [33]. John Gruber gab Apple Intelligence eine Schulnote "6" für 2025 [34]. Das ist nicht das Verhalten eines Unternehmens, das eine brillante Langzeitstrategie umsetzt. Es sieht eher nach organisatorischer Dysfunktion aus.

Apple kontrolliert nicht die Frontier-Modelle. IBMs Schwäche in der PC-Ära war, dass es weder das Betriebssystem (Microsoft) noch den Prozessor (Intel) kontrollierte. Apples potenzielle Schwäche in der KI-Ära: Es kontrolliert nicht die Frontier-Modelle. Es arbeitet mit OpenAI [35], Google [36] und (beinahe) Anthropic [37] zusammen. Wenn einer dieser Partner dauerhafte Dominanz erreicht - zum "Microsoft" der KI wird - könnte Apples Rolle als bloßer Distributionskanal dazu führen, dass es weniger Wert abschöpft als der Modellanbieter.

Das Verbraucherverhalten könnte sich ändern. Die gesamte On-Device-These nimmt an, dass Konsumenten den Großteil ihrer KI-Interaktionen weiterhin über ihre bestehenden Geräte abwickeln. Aber was, wenn KI-Assistenten, Smart Glasses oder völlig neue Formfaktoren auftauchen, die das iPhone umgehen? Eddy Cue, Apples SVP of Services, gab in einer Gerichtsaussage zu [38]: "Du brauchst vielleicht in 10 Jahren kein iPhone mehr."

Das sind reale Risiken, und sie sollten nicht abgetan werden. IBMs Fall war nicht unvermeidlich - er war das Ergebnis spezifischer Entscheidungen (offene Architektur, ausgelagertes Betriebssystem), die ein Platzhirsch mit IBMs Ressourcen hätte vermeiden können. Apples aktuelle Probleme deuten darauf hin, dass das Unternehmen zu ähnlichen Fehlern fähig ist.

Was das für Product Leader bedeutet

Egal ob du Produkte in einem Startup baust oder ein Produktteam in einem Konzern führst - der Mainframe-zu-KI-Übergang bietet sechs strategische Lektionen.

1. Beobachte, wohin sich Computing bewegt, nicht wo es heute steht.

Der häufigste Fehler während eines Plattformwechsels ist, für die aktuelle Architektur zu optimieren. In den späten 1970ern sagte jede rationale Analyse, Mainframes seien überlegen. Das stimmte. Aber Computing bewegte sich von zentralisiert zu verteilt. Heute sagt jede rationale Analyse, Cloud-KI-Modelle seien überlegen. Das stimmt. Aber KI-Compute bewegt sich von der Cloud an die Edge [24]. Product Leader sollten fragen: Wo wird KI-Inference in drei Jahren stattfinden? - und für diese Welt bauen.

2. "Gut genug" ist der gefährlichste Satz in der Strategie.

Wenn On-Device-Modelle "gut genug" für die tatsächlichen täglichen Aufgaben deiner Nutzer sind - nicht für ihre theoretischen Maximalanforderungen - verliert Cloud-KI ihren Vorteil für diese Anwendungsfälle. Ordne die KI-Bedürfnisse deiner Nutzer auf einem Spektrum von "braucht Frontier Reasoning" bis "braucht schnelle, private Basisintelligenz" ein. Wenn die meisten deiner Anwendungsfälle zum zweiten Ende tendieren, ist On-Device deine Zukunft. Beobachte die "gut genug"-Linie [6] obsessiv - sie verschiebt sich schneller als du denkst.

3. Distribution schlägt Fähigkeit in Consumer-Märkten.

IBM baute die besten Mainframes. Sie verloren trotzdem. Ben Thompson hat überzeugend argumentiert [39], dass Christensens Disruptions-Framework am zuverlässigsten auf B2B-Märkte zutrifft - aber in Consumer-Märkten kann die User Experience nicht "überschossen" werden. Die Lektion: Wenn du KI-getriebene Produkte baust, kann es wertvoller sein, 100 Millionen Nutzer mit einer "gut genug"-On-Device-Erfahrung zu erreichen, als 1 Million Nutzer mit einer State-of-the-Art-Cloud-Erfahrung. Denke darüber nach, wo deine Nutzer sind und wie du sie erreichst.

4. Die Wertschöpfungsschicht verschiebt sich bei Übergängen.

Bei Mainframes lag der Wert in integrierter Hardware-Software. Bei PCs wanderte er zur Betriebssystem- und Prozessorschicht. Ein Harvard Business School Paper [40] dokumentierte diesen "vertikalen-zu-horizontalen" Übergang im Detail. Bei Cloud-KI liegt der Wert derzeit in der Modellerstellung. Aber wenn Modelle commoditisieren, wandert der Wert zu den Schichten Distribution, Vertrauen und User Experience. Product Leader sollten ehrlich bewerten: Wo wird sich Wert im KI-Stack in 3-5 Jahren ansammeln? Dort bauen, nicht wo der Wert heute sitzt.

5. On-Device-Inference bringt KI-Produktökonomie zurück zu SaaS.

Das ist vielleicht das praktischste Insight für Product Manager, die heute KI-getriebene Produkte bauen.

Wenn dein Produkt KI-Inference in der Cloud ausführt, zahlst du für jeden API-Call. Jede Nutzeranfrage kostet dich Geld. Je erfolgreicher dein Produkt, desto höher deine Inference-Rechnung. Das bricht das traditionelle SaaS-Modell, bei dem die Grenzkosten pro Nutzer nahe null sind. Cloud-KI macht Software wieder zu einem Geschäft mit variablen Kosten - und viele Startups stellen fest, dass ihre Unit Economics im Scale nicht funktionieren, weil Inference-Kosten ihre Margen auffressen.

Aber wenn KI auf dem Gerät läuft, übernimmt die Hardware des Nutzers die Arbeit. Deine Grenzkosten pro Inference? Null. Genau wie bei traditionellem SaaS. Du lieferst das Modell einmal aus, der Nutzer führt es lokal aus, und deine Kostenstruktur bleibt flach, egal wie viele Anfragen gestellt werden.

Wenn du deine KI-Features für On-Device designen kannst - mit Apples Foundation Models Framework oder Open-Source-Modellen über Tools wie llama.cpp oder MLX - stellst du SaaS-ähnliche Ökonomie wieder her. Deine Bruttomargen bleiben hoch. Deine Preisgestaltung kann Abo-basiert sein, ohne dass versteckte variable Kosten dein Geschäft von innen auffressen. Und dein Produkt funktioniert offline, reagiert sofort und schützt die Privatsphäre der Nutzer als Bonus.

Die Produkte, die herausfinden, wie sie so viel Intelligenz wie möglich an die Edge bringen - und die Cloud nur für Aufgaben nutzen, die sie wirklich brauchen - werden einen strukturellen Kostenvorteil gegenüber Wettbewerbern haben, die standardmäßig auf Cloud-first-KI setzen.

6. Zeitkompression lässt weniger Raum für Geduld.

Der Mainframe-zu-PC-Übergang dauerte 15 Jahre. Die Smartphone-Revolution 5. KI-Übergänge könnten sich auf 2-3 Jahre komprimieren. Apples "spät, aber integriert"-Playbook [41] hat historisch funktioniert, weil genug Zeit war, zu beobachten, zu lernen und umzusetzen. Mit ChatGPT, das in nur zwei Jahren über 200 Millionen monatlich aktive Nutzer erreichte, ist das Fenster für Geduld enger denn je. Egal ob du als Platzhirsch bestehende Umsätze schützt oder als Startup disruptieren willst - Geschwindigkeit zählt mehr als in jedem vorherigen Technologiezyklus.

Das Fazit: Apple baut den PC der KI

Lass mich direkt sagen, wo ich bei dieser Frage stehe.

Das Mainstream-Narrativ sagt, Apple verliert das KI-Rennen, weil es nicht die besten Modelle hat, nur einen Bruchteil dessen ausgibt, was Wettbewerber ausgeben, und Siri peinlich ist. Das stimmt alles.

Aber das Mainstream-Narrativ bewertet Apple so, als würde es darum konkurrieren, den besten Mainframe zu bauen. Das tut es nicht.

Apple konkurriert darum, den Personal Computer der KI zu bauen - das Gerät, das Intelligenz in deine Tasche, auf deinen Schreibtisch und an dein Handgelenk bringt. Privat. Sofort. Persönlich. Immer verfügbar. Angetrieben von Silizium, das genau für diesen Zweck entwickelt wurde, verteilt auf 2,5 Milliarden Geräte, die Menschen bereits besitzen und lieben.

Die Cloud-KI-Giganten geben 690 Milliarden Dollar für zentralisierte Infrastruktur aus [2]. Apple gibt 13 Milliarden Dollar dafür aus, das Silizium zu bauen, das zentralisierte Infrastruktur für das überflüssig macht, was Konsumenten tatsächlich mit KI tun.

Geschichte wiederholt sich nicht, aber sie reimt sich. In den 1980ern wurde niemand jemals gefeuert, weil er IBM kaufte. In den 2020ern wird niemand kritisiert, weil er auf OpenAI baut. Aber die Unternehmen, die Rechenleistung in die Hände der Menschen legten - Apple, Microsoft, Intel und die Klonhersteller - eroberten die nächste Ära.

Die Frage ist nicht, ob Apple ein besseres Modell als GPT-5 bauen wird. Das wird es nicht. Die Frage ist, ob ein 3-Milliarden-Parameter-Modell, das sofort und privat auf deinem iPhone läuft, gut genug sein wird für 90 % dessen, was du jeden Tag tatsächlich mit KI machst.

Wenn die Antwort ja lautet - und die Entwicklung deutet stark darauf hin [17] - dann wird die 690-Milliarden-Dollar-Mainframe-Ära der KI irgendwann etwas Persönlicherem, Verteilterem und Apple-Förmigem weichen.

Die größten Gewinner der KI-Ära sind vielleicht nicht die Unternehmen, die die größten Modelle bauen. Sondern die, die Intelligenz in jede Hosentasche bringen.

Bei der Product Masterclass bilden wir Produktmanager für die KI-Ära aus. Unser 8-wöchiges Intensivprogramm deckt alles ab - von Kundeninterviews über Vibe Coding bis zum Aufbau deines persönlichen KI-Workflows. Schau dir die nächste Kohorte an

Quellen

[1] "Historical Interlude: From the Mainframe to the Minicomputer - IBM and the Seven Dwarfs," They Create Worlds. https://videogamehistorian.wordpress.com/2014/11/08/historical-interlude-from-the-mainframe-to-the-minicomputer-part-2-ibm-and-the-seven-dwarfs/

[2] "AI Capex 2026: The $690B Infrastructure Sprint," Futurum Group, February 2026. https://futurumgroup.com/insights/ai-capex-2026-the-690b-infrastructure-sprint/

[3] "Hyperscaler capex > $600 bn in 2026," IEEE ComSoc Technology Blog, December 2025. https://techblog.comsoc.org/2025/12/22/hyperscaler-capex-600-bn-in-2026-a-36-increase-over-2025-while-global-spending-on-cloud-infrastructure-services-skyrockets/

[4] "OpenAI's $1 Trillion Infrastructure Spend," Tomasz Tunguz, November 2025. https://tomtunguz.com/openai-hardware-spending-2025-2035

[5] "Betting on the mainframe pays off for IBM," The Irish Times. https://www.irishtimes.com/business/betting-on-the-mainframe-pays-off-for-ibm-1.1137074

[6] The Innovator's Dilemma: When New Technologies Cause Great Firms to Fail, Clayton Christensen, 1997. https://en.wikipedia.org/wiki/The_Innovator%27s_Dilemma

[7] "The IBM PC," IBM History. https://www.ibm.com/history/personal-computer

[8] "How the IBM PC Won, Then Lost, the Personal Computer Market," IEEE Spectrum. https://spectrum.ieee.org/how-the-ibm-pc-won-then-lost-the-personal-computer-market

[9] "How IBM Crashed, Then Rebooted With a $24 Billion Comeback," Leaders.com. https://leaders.com/articles/business/ibm-history/

[10] "Big Tech's $405B Bet: Why AI Stocks Are Set Up for a Strong 2026," IO Fund, November 2025. https://io-fund.com/ai-stocks/ai-platforms/big-techs-405b-bet

[11] "Neural Engine," Apple Wiki. https://apple.fandom.com/wiki/Neural_Engine

[12] "Apple introduces M4 chip," Apple Newsroom, May 2024. https://www.apple.com/newsroom/2024/05/apple-introduces-m4-chip/

[13] "The AI tsunami: Apple's M5 chip delivers a 12x performance leap," TechRadar, October 2025. https://www.techradar.com/pro/the-ai-tsunami-apples-m5-chip-delivers-a-12x-performance-leap-heres-what-the-neural-accelerators-mean-for-your-mac

[14] "Apple unleashes M5, the next big leap in AI performance for Apple silicon," Apple Newsroom, October 2025. https://www.apple.com/newsroom/2025/10/apple-unleashes-m5-the-next-big-leap-in-ai-performance-for-apple-silicon/

[15] "Introducing Apple's On-Device and Server Foundation Models," Apple Machine Learning Research, June 2024. https://machinelearning.apple.com/research/introducing-apple-foundation-models

[16] "Apple introduces M4 Pro and M4 Max," Apple Newsroom, October 2024. https://www.apple.com/newsroom/2024/10/apple-introduces-m4-pro-and-m4-max/

[17] "On-Device LLMs in 2026: What Changed, What Matters, What's Next," Edge AI and Vision Alliance, January 2026. https://www.edge-ai-vision.com/2026/01/on-device-llms-in-2026-what-changed-what-matters-whats-next/

[18] "Neural Engine," Wikipedia. https://en.wikipedia.org/wiki/Neural_Engine

[19] "Why AI's next phase will likely demand more computational power, not less," Deloitte TMT Predictions 2026. https://www.deloitte.com/us/en/insights/industry/technology/technology-media-and-telecom-predictions/2026/compute-power-ai.html

[20] "Private Cloud Compute: A new frontier for AI privacy in the cloud," Apple Security Research. https://security.apple.com/blog/private-cloud-compute/

[21] "On-Device LLMs: State of the Union, 2026," Vikas Chandra, Meta AI Research. https://v-chandra.github.io/on-device-llms/

[22] "Apple supercharges its tools and technologies for developers," Apple Newsroom, June 2025. https://www.apple.com/newsroom/2025/06/apple-supercharges-its-tools-and-technologies-for-developers/

[23] "Edge AI: The future of AI inference is smarter local compute," InfoWorld, January 2026. https://www.infoworld.com/article/4117620/edge-ai-the-future-of-ai-inference-is-smarter-local-compute.html

[24] "2026 AI story: Inference at the edge, not just scale in the cloud," R&D World, December 2025. https://www.rdworldonline.com/2026-ai-story-inference-at-the-edge-not-just-scale-in-the-cloud/

[25] "Apple's 2026 AI Inflection: Quantifying the Growth from 2.5 Billion Devices," Ainvest, February 2026. https://www.ainvest.com/news/apple-2026-ai-inflection-quantifying-growth-2-5-billion-devices-2602/

[26] "15 Most Used Generative AI Chatbots [July 2025 Rankings & Stats]," DarwinApps. https://www.blog.darwinapps.com/blog/15-most-used-generative-ai-chatbots

[27] "Apple appears to be sitting out the AI arms race. Will the strategy work?" CNBC, February 2026. https://www.cnbc.com/2026/02/27/apple-appears-to-be-sitting-out-the-ai-arms-race-will-the-strategy-work.html

[28] "How Apple Is Winning the AI Race - by Staying Out of It," The Motley Fool, February 2026. https://www.fool.com/investing/2026/02/10/why-apple-is-winning-the-ai-race-by-staying-out/

[29] "2025 will be remembered for what Apple didn't deliver," Macworld. https://www.macworld.com/article/3019152/2025-what-apple-didnt-deliver.html

[30] "Apple AI Head John Giannandrea to Leave After Chaotic Stint," Bloomberg, December 2025. https://www.bloomberg.com/news/articles/2025-12-01/apple-artificial-intelligence-head-to-leave-after-ai-struggles

[31] "Inside Tim Cook's push to get Apple back in the AI race," Artificial Intelligence News. https://www.artificialintelligence-news.com/news/inside-tim-cook-push-to-get-apple-back-in-the-ai-race/

[32] "Apple Intelligence errors with news alerts keep piling up," 9to5Mac, January 2025. https://9to5mac.com/2025/01/03/apple-intelligence-errors-with-news-alerts-keep-piling-up/

[33] "Apple sued for false advertising over Apple Intelligence," Axios, March 2025. https://www.axios.com/2025/03/20/apple-suit-false-advertising-ai-intelligence

[34] "My 2025 Apple Report Card," Daring Fireball, February 2026. https://daringfireball.net/2026/02/my_2025_apple_report_card

[35] "OpenAI rolls out ChatGPT for iPhone in landmark AI integration with Apple," VentureBeat. https://venturebeat.com/ai/openai-rolls-out-chatgpt-for-iphone-in-landmark-ai-integration-with-apple

[36] "The Apple-Google AI Deal: What $1 Billion Says About Who's Really Winning the AI Race," Security Boulevard, February 2026. https://securityboulevard.com/2026/02/the-apple-google-ai-deal-what-1-billion-says-about-whos-really-winning-the-ai-race/

[37] "Apple could have used Claude to power a future Siri, but Anthropic got greedy," AppleInsider, January 2026. https://appleinsider.com/articles/26/01/30/apple-could-have-used-claude-to-power-a-future-siri-but-anthropic-got-greedy

[38] "Apple is facing pressure from Wall Street to figure out its AI strategy," CNBC, July 2025. https://www.cnbc.com/2025/07/30/apple-ai-hardware-devices.html

[39] "What Clayton Christensen Got Wrong," Stratechery by Ben Thompson, 2013. https://stratechery.com/2013/clayton-christensen-got-wrong/

[40] "Explaining the Vertical-to-Horizontal Transition in the Computer Industry," Harvard Business School Working Paper. https://www.hbs.edu/ris/Publication%20Files/17-084_008a9781-260b-41e1-9d78-4872817eb71f.pdf

[41] "Apple and the late-mover advantage," Mobile World Live. https://www.mobileworldlive.com/latest-stories/apple-and-the-late-mover-advantage/

Wohin entwickelt sich Produktmanagement als Nächstes?

Bleib auf dem Laufenden mit unserem Product Newsletter und verpasse keine kostenlosen Artikel, Videos, Templates und Produktmanagement Events.

.png)